Seguendo sempre il testo di Segré troviamo un elenco sterminato di persone lungo la storia della teoria cinetica: Bernoulli (1738), Avogadro (1811), Herapath (1820) e Waterston (1851), Rayleigh, Kroenig (1822-1879), ancora Clausius (1857), Maxwell (1859, 1860, 1867), Boltzmann (1866, 1871, 1872, 1877), Zermelo, Loschmidt, Watson (1876), Liouville, Cagniard (1822), Andrews, Cailletet, Pictet, Deville, Wroblewski, Olzewski, Dewar, Onnes (1908), van der Waals (1873), Gibbs, Helmholtz, Planck, Einstein.

Vediamo perché la teoria cinetica, in particolare con il lavoro di Clausius, Maxwell ma soprattutto Boltzmann, giustifica il secondo principio della termodinamica e dunque riformuliamo adeguatamente la freccia del tempo.

Nel 1866 Boltzmann trovò un risultato valido però solo per processi reversibili, e nel 1871 anche Clausius, indipendentemente. Nel 1867 Maxwell cercò di dare una prova rigorosa della distribuzione delle velocità molecolari di un gas in equilibrio, scoperta nel 1859; inoltre fu proprio Maxwell a intuire la natura statistica del secondo principio della termodinamica e il passaggio dunque dall’impossibilità di alcuni fenomeni (secondo la formulazione di Clausius o di Kelvin) ad una altissima improbabilità che tali fenomeni si osservino.

Ma nel 1871 e 1872 abbiamo il grande passo dovuto a Boltzmann che trovò come cambia la distribuzione delle velocità di un gas passando attraverso stati di non-equilbrio e raggiungendo l’equilibrio (grazie alla sua equazione del trasporto il cui studio è ancora attuale). L’ingrediente essenziale sono gli urti tra le molecole e quella che è definita al giorno d’oggi l’ipotesi di caos molecolare.

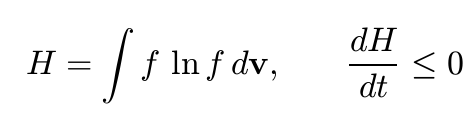

Ma non è finita qui. Boltzmann formulò il famoso teorema H definendo questa grandezza fisica (che altri non è che l’opposto dell’entropia definita da Clausius, divisa per la costante di Boltzmann!) su basi microscopiche e dimostrando, sempre sotto ipotesi di caos molecolare, che H diminuisce nel tempo durante il passaggio di un gas da stati di non-equilibrio allo stato finale di equilibrio, regolato dalla distribuzione di Maxwell delle velocità. Infine il sistema all’equilibrio mantiene costante nel tempo il suo valore di H. In formule (il simbolo dopo l’uguale indica un integrale, è una somma di infiniti addendi, comunque più avanti trovi una formula più semplice per l’entropia S)

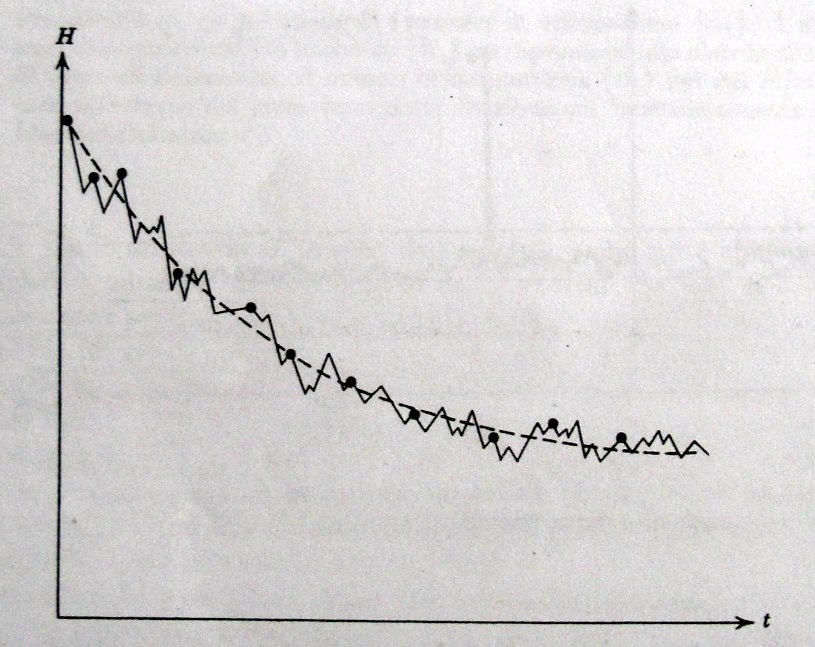

Boltzmann migliorò il suo lavoro nel 1877, in risposta a obiezioni quali il paradosso di reversibilità e il paradosso di ricorrenza. Da queste discussioni emerse chiaramente che il valore di H diminuisce o rimane costante solo trascurando sue piccole fluttuazioni che sono comunque in un certo senso collegate all’elevata improbabilità della violazione della seconda legge della termodinamica. Tale improbabilità dipende inoltre anche dall’elevato numero di particelle che costitutiscono il gas.

La formulazione attuale nei libri di testo – dovuta storicamente a Max Planck, così come la paternità nell’assegnazione del termine “costante di Boltzmann” – è che l’entropia vale (in una forma generalissima)

con “k” costante universale, “ln” logaritmo e “W” il numero di stati microscopici compatibili con i vincoli macroscopici e che il secondo principio denota l’altissima probabilità di un sistema di raggiungere l’equilibrio, in quanto il numero di microstati associati allo stato finale di equilibrio è enormemente maggiore di quello relativo ad altri stati, chiamati atipici da alcuni fisici che stanno proseguendo anche oggi il lavoro di Boltzmann. Si parla in questo caso di comportamento tipico di un sistema.

Possiamo allora riformulare la freccia del tempo in questo modo: se all’interno di un sistema isolato – che ha un comportamento tipico – avviene un qualsiasi fenomeno irreversibile allora la sua entropia aumenta – a meno di piccolissime e rarissime fluttuazioni – e dunque il sistema stesso evolve dal passato (S iniziale al tempo iniziale) verso il futuro (S finale al tempo finale).

E possiamo avere la garanzia che tale formulazione è valida per un gas composto da numerosissime particelle (si pensi al numero di Avogadro), molto rarefatto e debolmente interagente (con urti binari), che passa da uno stato di non equilibrio (tutte le particelle disposte inizialmente in un angolo di un spazio vuoto isolato e di forma cubica) allo stato finale stabile di equilibrio (secondo la distribuzione delle velocità di Maxwell).

Abbiamo collegato, anche con ingredienti di statistica, la meccanica microscopica alla termodinamica macroscopica, mostrando come la freccia del tempo non sia solo un fenomeno banalmente osservabile dai nostri occhi, ma emerga anche da principi primi fondamentali – come la conservazione dell’energia e la dinamica di un sistema di corpi interagenti – che sono anche a fondamento della comprensione fisica dell’essere umano.